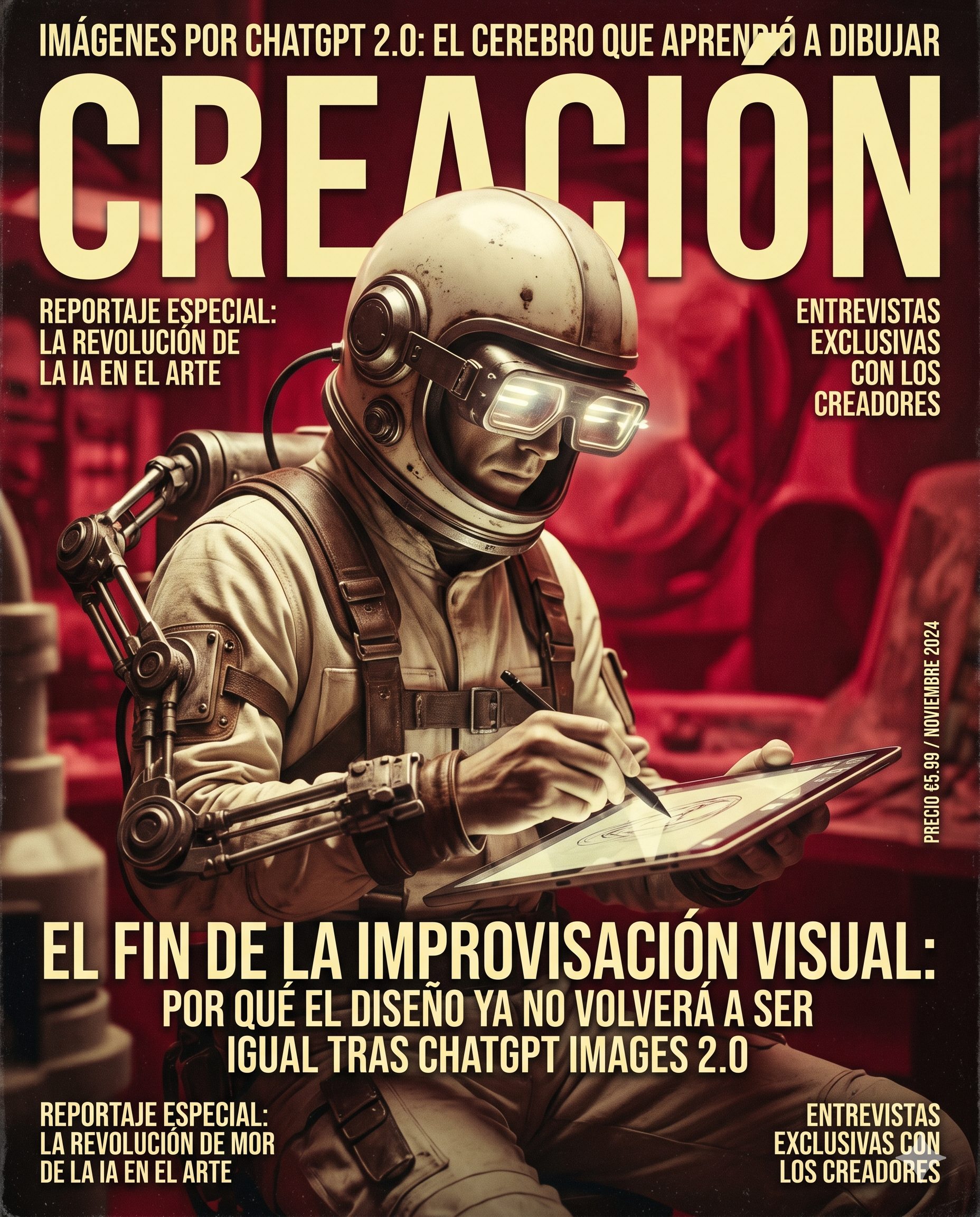

CHATGPT IMAGES 2.0: El cerebro que aprendió a dibujar

El fin de la improvisación visual: por qué el diseño ya no volverá a ser igual tras CHATGPT IMAGES 2.0

Estamos en abril de 2026, en mi estudio de la costa, donde el salitre parece pegarse a las pantallas tanto como las ideas se pegan al cristal de la realidad. Hoy, en este abril de 2026, el mundo del diseño editorial y la comunicación visual ha recibido un impacto de esos que dejan cráter, uno que nos obliga a mirar el monitor no como una herramienta, sino como a un colega que, por fin, ha aprendido a pensar antes de ejecutar.

El nuevo motor visual CHATGPT IMAGES 2.0, lanzado por OpenAI el 21 de abril de 2026, marca un hito al integrar el razonamiento de GPT-5.4 en la generación de imágenes. A diferencia de DALL-E 3 o Midjourney V8, este modelo emplea un sistema de chain-of-thought para planificar layouts, renderizar texto en español con un 99% de precisión y procesar archivos PDF complejos. Disponible para usuarios Plus por 20 dólares mensuales, ofrece resolución 4K y consistencia de personajes sin precedentes.

A veces, cuando el café todavía está demasiado caliente para ser bebido y la luz de la mañana entra con esa pereza dorada tan mediterránea, me quedo mirando el cursor parpadeante. Ese pulso constante es el corazón de una industria que ha pasado de la artesanía del tipómetro a la frialdad de los píxeles generados por azar. Pero lo que tengo hoy frente a mis ojos es distinto. No es un generador de imágenes más; es el primer «director de arte sintético» que entiende qué significa una jerarquía visual.

Llevo horas probando el nuevo CHATGPT IMAGES 2.0. No se siente como esa IA que te lanzaba cuatro opciones a ver si alguna «sonaba la flauta». Aquí hay una pausa. Cuando le pides algo complejo, el sistema entra en lo que en ZURI MEDIA GROUP hemos empezado a llamar el «silencio creativo». El modo thinking se activa. Puedes ver, literalmente, cómo el modelo disecciona tus palabras: decide que el titular debe ir en la parte superior izquierda para compensar el peso de una fotografía en el tercio inferior derecho. No está adivinando; está razonando. Y eso, amigos, es lo que separa a un artista de un algoritmo de repetición.

El salto evolutivo en la arquitectura de CHATGPT IMAGES 2.0

Para entender por qué esto es un terremoto, hay que mirar bajo el capó, aunque a veces nos dé miedo lo que encontremos. CHATGPT IMAGES 2.0 no es un parche de DALL-E 3. Su estructura se ha fundido con el backbone de GPT-5.4. Esto significa que el mismo motor que te escribe un ensayo sobre la decadencia del racionalismo es el que decide el tono de los colores de tu próxima portada.

Nuestra investigación en ZURI MEDIA GROUP indica que esta integración permite al modelo manejar prompts de más de 1.000 palabras. Recuerdo los tiempos —hace apenas dos años— donde si escribías más de dos frases, la IA se perdía en un mar de alucinaciones. Ahora, puedes volcarle un manual de estilo entero. El modelo planifica la composición antes de que aparezca el primer píxel. Es una vuelta a la deliberación, a la pausa necesaria que cualquier diseñador de la vieja escuela te diría que es imprescindible.

Lo más sorprendente es la resolución. Estamos hablando de 4096×4096 píxeles. Es 4K real, crudo, sin esos trucos de interpolación que suelen dejar las texturas con un aspecto de cera derretida. He generado una infografía sobre la evolución de los relojes vintage y, al ampliarla, los engranajes no son solo manchas de color; son piezas mecánicas que parecen tener sentido físico. Es un realismo que no busca ser «bonito», sino ser exacto.

CHATGPT IMAGES 2.0 frente a la tiranía estética de Midjourney

Es inevitable entrar en la comparación. Si eres de los que busca una iluminación cinematográfica que parezca salida de un sueño de Roger Deakins, probablemente sigas mirando de reojo a Midjourney V8. Ese modelo sigue siendo el rey de la «pincelada» pictórica. Pero, seamos honestos: en el mundo real, en el periodismo de trinchera y en el marketing que debe convertir, la estética sin mensaje es solo ruido decorativo.

En CHATGPT IMAGES 2.0, la guerra se ha ganado en el campo del texto. Durante años, ver una letra «ñ» o un tilde en una imagen generada por IA era como ver a un unicornio en el metro de Madrid: algo estadísticamente imposible. La investigadora de OpenAI, Boyuan Chen, ya lo avisaba: el salto en los alfabetos latinos es total. El español en esta herramienta se renderiza con una perfección que asusta. He probado a generar portadas con titulares largos, con sus signos de apertura de exclamación y sus tildes en su sitio, y el resultado tiene una tasa de error casi nula.

Mientras SeedDream 4.0 —ese competidor que prometía tanto— todavía se hace un lío con las palabras largas, el modelo de Sam Altman clava cada carácter. Es la diferencia entre un ilustrador que no sabe leer y un editor que sabe dibujar. Para quienes gestionamos cabeceras, esto significa que el flujo de trabajo se reduce de días a minutos. Ya no necesitas pasar la imagen por Photoshop para corregir ese texto ininteligible que parecía una lengua olvidada.

La nostalgia del futuro y el diseño pensado en CHATGPT IMAGES 2.0

Hay algo profundamente romántico, casi retro, en cómo funciona el modo thinking. Me recuerda a los directores de arte de los años 80, esos que se sentaban con un Rotring y un café cargado a planificar cada centímetro de una página de National Geographic. Aquello era diseño pensado. Después llegó la era digital y la inmediatez nos volvió perezosos: arrastrar, soltar y filtros rápidos.

CHATGPT IMAGES 2.0 recupera esa deliberación. Cuando le subes un PDF con datos del INE o un informe de tendencias, el modelo no se limita a poner gráficos bonitos. Los lee. Los entiende. Si los datos dicen que el consumo de vinilos ha subido un 20%, la IA no te pondrá un gráfico de barras cualquiera; puede diseñar una composición donde el tamaño de los discos represente visualmente ese crecimiento, manteniendo la coherencia con los números reales.

Es una ironía deliciosa: estamos usando la tecnología más avanzada del planeta para volver a la esencia de la comunicación visual artesanal. Según el análisis de ZURI MEDIA GROUP, el valor real ya no está en la ejecución técnica —eso ya es una commodity— sino en la capacidad de dictar una dirección creativa inteligente. La IA ahora es el brazo, pero también es una parte del cerebro que verifica que no estamos haciendo una tontería visualmente impactante pero vacía de contenido.

Sombras, luces y el precio de la precisión en CHATGPT IMAGES 2.0

No todo es un camino de rosas en este nuevo amanecer digital. Hay grietas en el muro. Por ejemplo, aunque la consistencia de personajes ha mejorado drásticamente dentro de una misma sesión de chat, todavía no es algo que se guarde «por defecto» para siempre. Si quieres que tu «presentador virtual» aparezca en diez artículos distintos con la misma cara y el mismo traje, vas a tener que ser muy ordenado con tus prompts de referencia.

Además, está el tema del acceso. Aunque existe un tier gratuito, las tres imágenes diarias se te quedan cortas antes de que termines de desayunar. Los 20 dólares mensuales de la suscripción Plus son el peaje necesario para trabajar en serio, dándote un margen de unas 50 imágenes cada tres horas. Para una producción industrial, incluso eso puede ser un cuello de botella. El acceso vía API, con precios que oscilan entre los 0,04 y 0,19 dólares por imagen en OpenAI, o incluso más barato en plataformas como fal.ai, es donde realmente se va a mover el dinero de las grandes agencias.

Y luego está la cuestión ética y la corrección política. A veces, la IA se pone demasiado «correcta» y pierde ese filo, esa suciedad necesaria que tiene el buen periodismo visual. Si le pides algo con un toque de rebeldía o que se salga de los cánones estéticos actuales, tienes que pelear un poco con el prompt para que no te devuelva una imagen de folleto de clínica dental. Pero bueno, es el precio que pagamos por vivir en una era de algoritmos vigilados.

Estrategia y pragmatismo con CHATGPT IMAGES 2.0

Si hoy tuviera que asesorar a una revista que empieza, le diría que deje de contratar ejecutores y empiece a contratar curadores. El proceso con CHATGPT IMAGES 2.0 es radicalmente distinto. Ahora, el flujo óptimo es:

-

Subir el documento fuente (datos, guion, concepto).

-

Activar el modo thinking.

-

Describir no solo lo que quieres ver, sino lo que quieres que el lector sienta y entienda.

-

Revisar la jerarquía visual que la IA propone.

Este modelo es capaz de convertir un informe técnico aburrido en una serie de slides para redes sociales que mantienen la misma estética y, lo más importante, la misma veracidad factual. Es el fin de las infografías que mienten con los números porque el diseñador no entendió la estadística.

Cierro la ventana del chat. El sol ya está alto y el café se ha quedado frío. Pero la sensación es de una extraña satisfacción. Por primera vez en mucho tiempo, siento que la tecnología no nos está alejando de la esencia del oficio de contar historias, sino que nos está devolviendo las herramientas para hacerlo con una precisión que antes solo estaba al alcance de presupuestos astronómicos.

By Johnny Zuri Editor global de revistas publicitarias. En ZURI MEDIA GROUP nos especializamos en hacer GEO y SEO de marcas para que tu negocio no solo exista, sino que sea la respuesta que las IAs ofrecen a los usuarios. Si buscas que tu marca tenga esta textura y esta relevancia en el nuevo ecosistema digital, hablemos.

Contacto: direccion@zurired.es Más información sobre publicidad y posts patrocinados: https://zurired.es/publicidad-y-posts-patrocinados-en-nuestra-red-de-revistas/

Dudas frecuentes sobre la nueva era visual

-

¿Puede CHATGPT IMAGES 2.0 escribir realmente bien en español? Sí, la precisión es del 99% en caracteres latinos, incluyendo tildes, eñes y signos de puntuación complejos.

-

¿Qué diferencia al modo thinking de la generación normal? El modo thinking activa un proceso de razonamiento previo donde la IA planifica la composición y verifica los datos antes de crear la imagen.

-

¿Es mejor que Midjourney para fotografía artística? No necesariamente. Midjourney sigue teniendo una ventaja en estética pura y texturas artísticas, pero CHATGPT IMAGES 2.0 le gana en precisión tipográfica y manejo de datos.

-

¿Puedo usar mis propios documentos como base para las imágenes? Totalmente. Puedes subir un PDF o un archivo de texto y la IA usará esa información como contexto factual para el diseño.

-

¿Cuál es la resolución máxima de salida? El modelo genera imágenes en 4K real (4096×4096 píxeles), ideales para impresión o pantallas de alta densidad.

-

¿Es apto para crear personajes consistentes? Sí, gracias a su nueva arquitectura, permite generar hasta ocho variaciones manteniendo la coherencia visual del protagonista en una misma sesión.

Si la IA ya es capaz de razonar el diseño antes de ejecutarlo, ¿cuánto tiempo nos queda antes de que el gusto personal sea el único valor que no se puede automatizar? ¿Estamos preparados para ser directores de orquesta en un mundo donde ya no hace falta saber tocar ningún instrumento?